Bên cạnh những lợi ích hỗ trợ đắc lực cho con người, AI này cũng khiến các chuyên gia công nghệ lo ngại ChatGPT có thể bị lạm dụng cho mục đích như lừa đảo, tấn công mạng, lan truyền thông tin sai lệch…

Cơn sốt toàn cầu

ChatGPT được OpenAI phát hành thử nghiệm từ 30-11-2022, có thể đưa ra các câu trả lời giống một cuộc trò chuyện về nhiều lĩnh vực. Không như các chatbot hiện có, ChatGPT được xây dựng trên mô hình AI tiên tiến GPT-3.5, giúp phản hồi một cách tự nhiên và được đánh giá như người thật. Siêu AI này đã có 1 triệu người dùng chỉ sau 5 ngày ra mắt. Website dự án bị sập ngay khi vừa xuất hiện do quá tải. Ở các thị trường chưa được hỗ trợ, người dùng cũng tìm cách lách luật, thậm chí thuê tài khoản để có thể trải nghiệm ChatGPT.

|

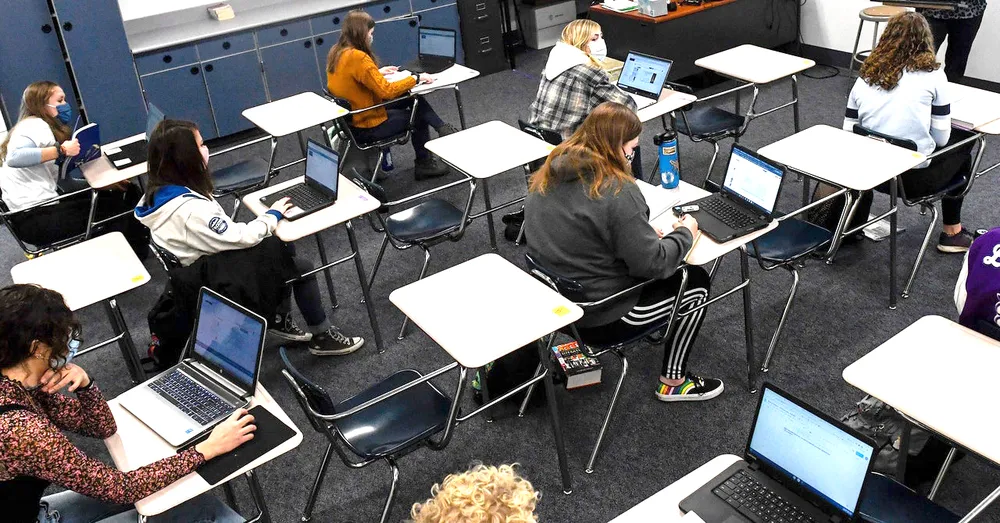

Ảnh minh họa của New York Times về ChatGPT len lỏi vào học đường |

Chỉ thông qua các câu hỏi từ người dùng, ChatGPT có thể tổng hợp dữ liệu và giải thích các khái niệm, tạo kịch bản phim, hay đưa ra lời khuyên về trang phục, công thức nấu ăn, lập trình, viết báo cáo khoa học... Một phóng viên của Insider đã ra lệnh cho siêu AI viết báo. Cách hành văn, diễn đạt thông tin của nó được đánh giá trôi chảy đến kinh ngạc, nhưng nội dung lại chứa thông tin sai lệch. “ChatGPT đã có mặt khắp nơi, từ trường học, bệnh viện đến trung tâm quảng cáo và trong cả những phòng nghiên cứu. Siêu AI đang mở ra một thời kỳ bùng nổ về khởi nghiệp trong lĩnh vực trí tuệ nhân tạo. Dường như ChatGPT có thể làm mọi thứ, miễn là con người nghĩ ra cách tận dụng nó”, Business Insider bình luận.

Theo Business Insider, giới nhân viên văn phòng thừa nhận họ đã dùng ChatGPT để phục vụ công việc. Một số coi ChatGPT như một trợ lý, yêu cầu nó thực hiện nhiều nhiệm vụ khó nhằn. Một nhân viên Amazon Web Services (AWS) tiết lộ, nhóm Hỗ trợ doanh nghiệp của họ gần đây dùng AI để nâng cao hoạt động kinh doanh và đạt được hiệu quả đáng kinh ngạc. Một số thừa nhận ChatGPT làm rất tốt việc hỗ trợ các câu trả lời hóc búa như khắc phục sự cố cơ sở dữ liệu. Một số khác dùng nó để tìm kiếm tài liệu ôn tập cho các kỳ thi cấp chứng nhận của AWS. Số khác nữa nói ChatGPT rất giỏi trong việc đưa ra dự án mục tiêu. Một nhân viên đã hỏi ChatGPT một số câu hỏi phỏng vấn của Amazon và mô hình đưa ra đáp án chính xác.

Insider cho biết, luật sư (giấu tên) của Công ty Amazon cảnh báo, nhân viên không được cung cấp cho siêu AI này bất kỳ thông tin bí mật nào của Amazon. “Đây là vấn đề nghiêm trọng vì dữ liệu đầu vào có thể được sử dụng để huấn luyện ChatGPT và chúng tôi không muốn đầu ra là những thông tin nội bộ của công ty”, luật sư viết.

Ngay chính những người tạo ra ChatGPT cũng bất ngờ vì mức độ phổ biến và đưa ra nhiều cảnh báo. Sam Altman - CEO OpenAI, cho biết, ông thực sự sốc khi ChatGPT quá phổ biến. Siêu AI không chỉ được người yêu thích công nghệ đón nhận mà còn len lỏi khắp các trường học, văn phòng, trở thành công cụ làm việc, học tập. “Thành thật mà nói, trong trường hợp xấu nhất, trí tuệ nhân tạo có thể là điểm kết thúc của tất cả chúng ta. Tôi nghĩ, chúng ta đã thích nghi với máy tính và những thay đổi trong lớp học toán khi máy tính cầm tay xuất hiện. AI có thể là một phiên bản cực đoan hơn, nhưng phải học cách chấp nhận nó khi lợi ích càng lớn, rủi ro càng cao”, CEO Open AI nói.

Dữ liệu đen huấn luyện AI

Cuộc điều tra của tờ Time cho thấy, để ChatGPT có thể nhanh chóng đưa ra câu trả lời ấn tượng, OpenAI sử dụng những lao động ở Kenya cho công việc kiểm duyệt nội dung với mức lương ít ỏi. Việc kiểm duyệt nội dung đặc biệt quan trọng. Ước tính với lượng dữ liệu OpenAI thu thập để huấn luyện trí tuệ nhân tạo, công ty này phải cần hàng trăm người làm trong hàng thập kỷ mới có thể rà soát toàn bộ dữ liệu thủ công.

Cách hiệu quả để hạn chế thiên kiến và sai lầm của AI là tạo một cơ chế an toàn khác bằng AI, tương tự cách những nền tảng lớn như Facebook đã thực hiện. OpenAI đã học tập và xây dựng AI có thể phát hiện ngôn ngữ thù địch để loại bỏ chúng khỏi nền tảng trước khi đem đến cho người dùng những câu từ sạch đẹp. Công ty cung cấp cho AI dữ liệu đầu vào là những ngôn từ mang tính bạo lực, kích động, thù địch, lạm dụng tình dục. Sau khi hấp thu lượng dữ liệu độc hại này, AI sẽ tự động phát hiện từ khóa, nội dung tương tự. Nền tảng sau đó tích hợp vào ChatGPT để kiểm soát, lọc dữ liệu được cho là không tốt trước khi đến tay người dùng. Nó cũng giúp xóa đi những văn bản độc hại khỏi bộ dữ liệu có sẵn của OpenAI, trước khi đào tạo các mô hình AI trong tương lai.

Sama, đối tác của OpenAI, công ty gia công phần mềm ở Kenya chuyên cung cấp lượng dữ liệu loại này. Công ty sẽ tìm kiếm nội dung độc hại từ nơi tăm tối nhất của internet, như những lời mô tả lạm dụng tình dục trẻ em, thú tính, giết người, tự tử, tra tấn, tự làm hại bản thân... để làm phong phú dữ liệu đầu vào cho các đối tác huấn luyện AI. Sama thay mặt OpenAI trả lương cho những người làm công tác dán nhãn dữ liệu với chi phí từ 1,32-2 USD/giờ, tùy thâm niên và hiệu suất. “Sứ mệnh của chúng tôi là đảm bảo AI mang lại lợi ích cho toàn nhân loại và chúng tôi nỗ lực xây dựng hệ thống AI an toàn và hữu ích nhằm hạn chế nội dung thiên vị và có hại. Phân loại, lọc nội dung có hại là bước cần thiết để giảm thiểu bạo lực và tình dục có trong dữ liệu đào tạo”, Time dẫn lời phát ngôn viên của OpenAI.

Thực tế khác hẳn, một nhân viên của Sama được giao nhiệm vụ đọc và dán nhãn văn bản cho OpenAI nói với Time rằng, anh thường xuyên bị ảo giác sau khi đọc mô tả bằng hình ảnh về một người đàn ông quan hệ tình dục một cách bệnh hoạn. “Đó là sự tra tấn. Bạn sẽ đọc những nội dung như vậy suốt cả tuần. Đây là môi trường làm việc độc hại với chúng tôi”, người này nói. 3 nhân viên cho biết, họ phải đọc và dán nhãn 150-250 đoạn văn bản mỗi ca làm việc kéo dài 9 tiếng. Những đoạn trích đó dài 100-1.000 từ. Tất cả nhân viên được phỏng vấn nói họ bị tổn thương tinh thần trầm trọng, dù đã được tham dự một số buổi tư vấn sức khỏe.

Tuy nhiên, giới chuyên gia cho biết, nhu cầu lao động dán nhãn dữ liệu cho các hệ thống AI sẽ ngày càng tăng khi ngành công nghiệp này phát triển. Andrew Strait, một nhà đạo đức học về AI, cho biết: “Chúng rất ấn tượng, nhưng ChatGPT và các mô hình AI không phải là ma thuật, chúng dựa vào chuỗi cung ứng khổng lồ về lao động của con người và nguồn dữ liệu thu thập được”.